Tag: SEO

Mitte der 1990er Jahre fingen die ersten Internet Suchmaschinen an, das frühe Web zu ordnen. Die Seitenbesitzer erkannten rasch den Wert einer bevorzugten Listung in Resultaten und recht bald entwickelten sich Behörde, die sich auf die Verfeinerung ausgebildeten.

In den Anfängen vollzogen wurde der Antritt oft zu der Transfer der URL der entsprechenden Seite bei der vielfältigen Search Engines. Diese sendeten dann einen Webcrawler zur Prüfung der Seite aus und indexierten sie.[1] Der Webcrawler lud die Homepage auf den Webserver der Suchmaschine, wo ein 2. Angebot, der gern genutzte Indexer, Infos herauslas und katalogisierte (genannte Ansprüche, Links zu ähnlichen Seiten).

Die zeitigen Modellen der Suchalgorithmen basierten auf Informationen, die dank der Webmaster selber vorhanden wurden von empirica, wie Meta-Elemente, oder durch Indexdateien in Suchmaschinen wie ALIWEB. Meta-Elemente geben einen Gesamtüberblick über den Thema einer Seite, dennoch registrierte sich bald heraus, dass die Inanspruchnahme der Tipps nicht zuverlässig war, da die Wahl der angewendeten Schlagworte durch den Webmaster eine ungenaue Beschreibung des Seiteninhalts widerspiegeln konnte. Ungenaue und unvollständige Daten in den Meta-Elementen vermochten so irrelevante Websites bei speziellen Stöbern listen.[2] Auch versuchten Seitenersteller vielfältige Fähigkeiten innert des HTML-Codes einer Seite so zu lenken, dass die Seite stärker in Ergebnissen aufgeführt wird.[3]

Da die frühen Search Engines sehr auf Punkte dependent waren, die nur in den Koffern der Webmaster lagen, waren sie auch sehr labil für Abusus und Manipulationen im Ranking. Um gehobenere und relevantere Vergleichsergebnisse in den Serps zu bekommen, musste ich sich die Besitzer der Suchmaschinen im Internet an diese Voraussetzungen adaptieren. Weil der Gelingen einer Suchseite davon abhängig ist, wichtige Ergebnisse der Suchmaschine zu den gestellten Suchbegriffen anzuzeigen, konnten untaugliche Resultate dazu führen, dass sich die Anwender nach weiteren Wege bei der Suche im Web umsehen. Die Antwort der Internet Suchmaschinen lagerbestand in komplexeren Algorithmen für das Ranking, die Faktoren beinhalteten, die von Webmastern nicht oder nur schwer lenkbar waren. Larry Page und Sergey Brin entworfenen mit „Backrub“ – dem Vorläufer von Suchmaschinen – eine Anlaufstelle, die auf einem mathematischen KI basierte, der anhand der Verlinkungsstruktur Websites gewichtete und dies in den Rankingalgorithmus reingehen ließ. Auch sonstige Suchmaschinen im WWW bezogen bei Folgezeit die Verlinkungsstruktur bspw. als der Linkpopularität in ihre Algorithmen mit ein.

Die Suchmaschine

What’s Robots.txt & The right way to Create Robots.txt File? | search engine optimisation tutorial

The best way to create your Amazon product itemizing step by step – Straightforward website positioning & optimization tutorial 2022

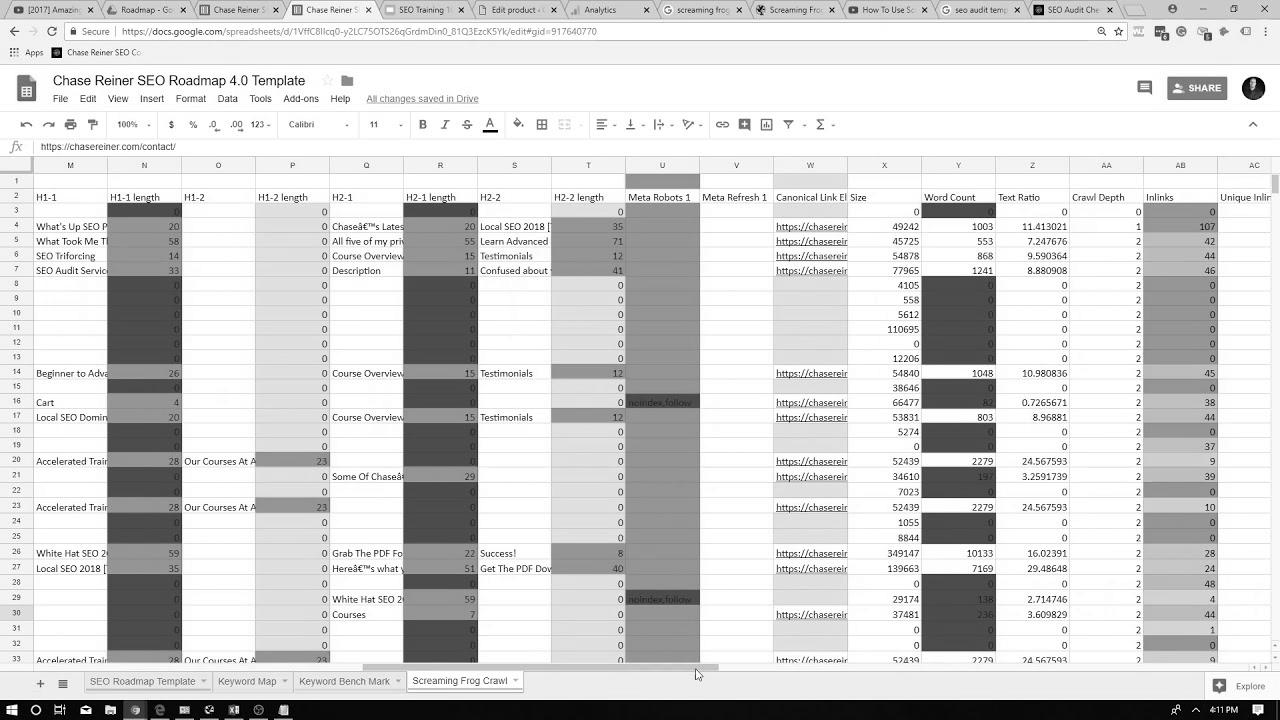

Mehr zu: How To Create The Ultimate SEO Audit (2018 Up to date)

How to make BEST Thumbnails for YouTube Movies – search engine optimisation Search Engine Optimization Strategies

![Lawless Lawyer – EP13 | Lee Joon Gi & {Seo|Search engine optimization|Web optimization|Search engine marketing|Search engine optimisation|Website positioning} Ye Ji Make Up [Eng Sub] Lawless Lawyer – EP13 | Lee Joon Gi & {Seo|Search engine optimization|Web optimization|Search engine marketing|Search engine optimisation|Website positioning} Ye Ji Make Up [Eng Sub]](/wp-content/uploads/2022/06/1655091739_maxresdefault.jpg)

Nachricht: Lawless Lawyer – EP13 | Lee Joon Gi & Website positioning Ye Ji Make Up [Eng Sub]

How To Create Content That Ranks Excessive In Search Engines – SPPC search engine optimisation Tutorial #8

YouTube Advertising and marketing Course 2022 🔥 | Full YouTube search engine optimization Tutorial & Tips

How can I make search engine marketing and Traffic Technology Easier?

Mitteilung: Key phrase Analysis for Ecommerce Website/On-line Retailer | Ecommerce web optimization